Mit dem Release von Veeam Backup & Replication v9 wurde die allgemeine Performance im Vergleich zu den Vorgängerversionen weiter verbessert. Version 8 lief schon sehr gut und hat überzeugende Resultate gezeigt. Mit Version 9 wurde das aber nochmals getoppt. Ebenso sind viele neue Features in die Software integriert worden. Drei kleine, vielleicht eher versteckte Features, möchte ich euch heute vorstellen. Sie sollen euch helfen noch etwas mehr Performance aus der Software rauszuholen und eure Backupzeitfenster weiter verkleinern.

Use per-VM backup files

Das erste der drei Feature ist auf Repository-Ebene zu finden und heisst “Per-VM Backup Files”. Wenn ihr einen Backup Job einrichtet und ihn auf das gewünschte Repository sichern lasst, macht Veeam erstmal eine grosse vbk-Datei und sichert dort alle VMs rein. Das gleiche passiert bei den darauf folgenden inkrementellen Sicherungen, da ists einfach eine grosse vib-Datei. Im Endeffekt wird einfach mit einem Stream auf das Repository geschrieben.

Mit der Funktion “Per-VM Backup Files” aus Version 9 sichert der Backup Job nicht mehr alles in einer Datei sondern erstellt für jede VM eine eigene Backup Chain. So könnt ihr das Repository besser auslasten und mehrere Streams parallel auf das Repository schreiben. Das steigert die Backup Performance erspart euch unter Umständen etwas Zeit beim Backup, da die Parallelisierung nicht nur im Job sondern auch auf Repository-Ebene genutzt werden kann. Ebenso hilfreich ist die Funktion, falls man eine VM restoren muss während das Backup läuft. So wird nicht das gesamte Backup-File durch Veeam blockiert sondern nur die Files die grad gesichert werden.

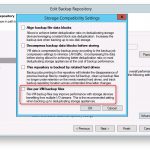

Macht einen Rechtsklick auf euer Repository => Edit => Repository => Advanced => Haken setzen bei “Use per-VM backup files”

Hinweis: bei einem leeren Repository wird diese Funktion beim nächsten Lauf des Backup Jobs aktiv. Bei einem Repository welches bereits genutzt wird muss erst ein Full Backup gemacht werden. Ab dem Startzeitpunkt des Full Backups wird pro VM eine Backup Chain erstellt.

Exclude deleted file blocks

Das zweite Feature ist auf Stufe Backup Job zu finden. Mit dem Aktivieren dieser Funktion werden gelöschte Datenblöcke innerhalb einer VM nicht mehr durch Veeam gesichert. Das erspart euch einige Gigabyte (oder vielleicht mehr) an Platz im Repository. Wenn man innerhalb einer VM Daten löscht (Platten bereinigt, Datenbanken verkleinert, grössere Datenmengen löscht) dann werden diese Blöcke als Frei / Überschreibbar markiert. Veeam achtet beim Changed Block Tracking darauf und sichert diese Blöcke, da sie sich ja verändert haben.

Wenn man nun die gelöschten Blöcke ausklammert mit dem Aktivieren dieser Funktion, weiss Veeam dass solche Blöcke nicht gesichert werden müssen, da sie gelöscht wurden und dort somit keine Daten enthalten sind.

Macht einen Rechtsklick auf den gewünschten Backup Job => Edit => Storage => Advanced => Storage

File Exclusions

Das dritte Feature im Bunde kennt man von diversen anderen Backupprogrammen. Neu in Version 9 können nun auch Dateien oder Ordner explizit vom Backup ausgeschlossen oder gegebenenfalls inkludiert werden. Dieses Feature findet man auf der Stufe der virtuellen Maschine. Vielleicht ist diese Funktion nicht unbedingt eine Performance-Optimierung. Aus meiner Erfahrung wird das Backupzeitfenster auf jeden Fall nicht sehr verlängert.

Nehmen wir einen WSUS-Server als Beispiel. Da liegen zig Gigabyte an Daten herum, Updates für Windows, Office und Co. und ihr wollt die nicht sichern. Das ist durchaus legitim. Sind ja Updates, kann man jederzeit wieder neu herunterladen. Das können aber auch andere Ordner oder Files sein, wie bspw. Druckertreiber. Ihr wisst selbst am Besten was ihr alles an Daten in eurer Infrastruktur habt.

Mit der Funktion von File Exclusions sagt ihr auf Stufe der VM welche Dateien oder Ordner ihr explizit nicht sichern wollt. Oder eben doch, wenn an einer VM noch eine Disk dranhängt, wo nur eine handvoll Ordner mit etwas an Daten drauf liegen. Dann könnt ihr explizit diesen Ordner angeben das er auch gesichert wird.

Macht einen Rechtsklick auf den gewünschten Backup Job => Edit => Guest Processing => Applications => Klickt die VM an => Edit => File Exclusions

Fazit zur Performance

Alles in allem drei doch sehr hilfreiche Funktionen, finde ich, wenn es um Performance und Platz sparen geht. Die Performance von Veam Backup & Replication sucht seinesgleichen. Ich persönlich kenne keine Backupsoftware die schnell mal über den Mittag in einer halben Stunde eine ganze vSphere Infrastruktur sichert. Klar, das ist sicher abhängig von den eingesetzten Komponenten (Hosts, Storage, Backupserver, Netzwerk etc.). Und wenn man da noch das eine oder andere Quäntchen rausholen kann, wieso nicht? Selbst physische Server können mittlerweile mit Veeam gesichert werden, bald sogar richtig sauber auch Exchange und SQL, inkl. Log-Truncation. Aber dazu zu einem späteren Zeitpunkt mehr…

Veeam Dateierweiterungen / Filetypes / weiterführende Links

| Dateierweiterung |

Beschreibung |

| .vbk |

Full backup file |

| .vib or .vrb |

incremental backup file |

| .vbm |

Backup Metadata |

| .bco |

Veeam configuration backup |

| .vsb |

Pointers to backup data blocks |

| .vlb |

SQL server transaction log files |